到 2030 年代末,世界将发生翻天覆地的变化。新的世界秩序将建立,很快人工智能将统治世界。——一名被解雇的员工

有时候我不明白为什么我的小爱同学甚至不能帮我定闹钟,但有些人担心人工智能会摧毁人类文明。

人工智能,一个“50后”概念,多年以来只存在于影视剧、科幻小说、报刊杂志中,如今高考作文必须写到人工智能。

事情确实变得有些奇怪了。半个多世纪以来,芯片计算能力一直忠实地遵循摩尔定律:性能大约每两年翻一番。

但从2012年开始,AI算力每100天就翻一番,2014年需要一整天才能训练的模型,到2018年只需两分钟就能完成,速度提升了30万倍。

难道有人把时钟往前调了?

看下面这张图,AI的学习速度确实快得出奇。

至今为止,人类只保留了五种未被超越的能力——但从成长速度(几乎是垂直增长)来看,这五种能力很快就会(或已经被)超越。

这就像养育了一个几十年的老孩子,突然看到他长成了一名大学生,并且在很多方面比“人类父母”更有能力。

父母不会因为孩子比自己强而焦虑,但人类不是AI的父母。

如果把人工智能看作一个物种,那么它的进化速度比人类快上千万倍。人类曾经创造了人工智能,但现在它发展得太快,我们逐渐失去了控制感。

这一切的根源是什么?

神秘的硅谷,奇怪的科学家

这位人工智能领域的绝对大师、2018年图灵奖获得者、“人工智能教父”曾表示:“我一生最后悔从事人工智能领域工作”。

这不像马云说后悔创办了阿里巴巴,半个世纪以来,他一直专注于阿里巴巴背后的核心技术,他的后悔,来自于对人工智能的失控感。

“这个东西居然会变得比人类更聪明。”类似的话在不止一处被说过,前不久还在一次电视采访中被反复强调:

“在未来5-20年内,人工智能有50%的可能性会比人类更聪明。当它们比我们更聪明时,我不知道我们被接管的可能性有多大,但在我看来,这种可能性非常大。”

这位昔日的人工智能传播者现在似乎已经变成了一位世界末日威胁理论家。

事实上不仅如此,几乎所有的商业领袖和科技领域的学术巨头都不同程度地表达了对AI的担忧。

6月4日,等公司员工发表公开信,披露其人工智能系统已接近人类水平。

AGI最有可能在2027年实现,但现在的AI公司并不值得信赖。

在AI领域,发公开信尤为盛行2023今晚澳门开特马,据不完全统计,近十年来公开信已有数十封详细讲解(2024年新奥门开奖结果)糟糕的人工智能,它能糟糕到什么程度?,其中比较著名的有以下几封:

这个团的人越来越多,阵容也越来越强。

但你会发现,信上的名字,微软、谷歌、Meta 等,几乎都是 AI 领域的主要参与者。谷歌是第一家在公开信上签名的公司,但在过去的十年里,谷歌收购的 AI 公司屈指可数。

研究人工智能的科学家在硅谷的大型科技公司中颇受欢迎,就连史蒂夫·乔布斯也在谷歌工作了十多年,而据最新消息,他刚刚加入了一家新的人工智能公司。

在这群人中,最著名、最典型的无疑就是马斯克,去年马斯克发起公开信,呼吁暂停AI训练六个月。

但几个月后,马斯克的xAI也来了。目前,该公司已获得数十亿美元的融资。

有人说马斯克的动机不纯粹。是的,你可以怀疑。但似乎每个人的动机都没有看上去那么纯粹?

比人类更强大的人工智能其实是一个黑匣子

也许若干年后,幸存者们撰写后人类时代的历史书时,会提到这一点:

21世纪我们的祖先曾经登上科技文明的巅峰,但是他们却犯了一个致命的错误——没有看清形势就任由人工智能飞速发展,直至一切都失控。

很难想象,科学家和企业家让人工智能迅速成长,却对它的进化却茫然无知。

如今人类的AI研究基本都遵循着图灵在20世纪50年代提出的思路,这位被誉为“人工智能之父”的人在1950年发表的一篇论文中写道:

“通过开发学习算法,然后教机器,而不是手工编写智能程序,创建人类级别的人工智能将更容易。”

这就是机器学习的雏形——人类退一步,只设计学习方法和规则,让机器自己学习。

图灵的方法非常有效,但许多人忘记了他提出这一方法后不久就警告说,实现这一目标可能不是对人类最好的事情。

先有方法和实现,再有理论阐述;先有智能技术,再有智能科学,我们的人工智能就是这样迭代发展的。

然而,研究人员逐渐发现深度学习和强化学习非常强大,让AI变得更加聪明,但没有人知道AI的智能从何而来,这被称为人工智能的黑箱问题。

未知会带来危险吗?没人知道。但我们应该保持谦虚和谨慎吗?

人类给出的答案是否定的。美国“原子弹之父”罗伯特·奥本海默曾说过:

“当人们看到某件事在技术上感觉良好时,他们就会去做。”

于是,核武器诞生了。

人工智能是一个黑箱,但并不妨碍数万亿资源进入这个领域,玩家们提出了一个更激进的说法,叫做法律。

解释一下,这句话的意思大致就相当于:发展AI,投入的算力和资源越多越好。这太符合资本扩张的神话了。

就像一群盲人划船,领头的人敲着鼓,喊着大家努力,但他却背对着船,不知道前面是否有悬崖。

人性是激进的,资本是大胆的,AI是未知的。

在学习机器一文中,图灵还提出了著名的图灵测试。机器能否像人一样进行对话,让人类无法分辨?长期以来,图灵测试成为判断机器是否具备“智能”的核心命题。

不久前,一项研究宣布 GPT-4 通过了图灵测试,54% 的人将其误认为真人。其实自 GPT 诞生以来,人们就一直热衷于让它参与图灵测试,但结果好坏参半。

有些人和马斯克一样,怀疑图灵测试无效。是的,诚实的人工智能参加测试只有两种结果——通过或失败。

那么不诚实的人工智能又如何呢?

更加集中,更加专制

现在AI圈的大佬们流行“逃跑”。

离开谷歌后,他的弟子伊利亚也离开了。在苹果、微软、Meta等科技巨头,很多人离开,也有很多人加入。

Brain团队的8名成员可以说是这一轮AI浪潮的奠基者,后来他们纷纷离开谷歌,创办或加入了新的公司。

伊利亚离开的时候,大家都很好奇,因为他身上有很多光环,比如首席科学家、父亲……

当然,最引人瞩目的是马斯克的一番煽动性言论——伊利亚到底看到了什么?

伊利亚曾在采访中表示:也许意识已经出现,未来人类会选择与机器融合,AI将永生。

听起来伊利亚更像是一个技术极客。

这是否意味着事情已经无法控制,所以我选择离开?

让我们看看其他人的故事。

2021年,离开的人被创造出来。正如这家公司的名字所暗示的那样(大致意思为“人类的选择”,宇宙的存在离不开人类),他们的使命是创造安全可控的AI。

但该公司员工预测,未来三年可能是他在工作的最后几年,因为他的工作即将被人工智能取代。

“随着我们模型的每次迭代,我都面临着比以前更强大、用途更广的技术,这些技术可能会终结我们今天所知的就业……[鉴于此],我们应该如何看待工作的消失?”

有一句话很流行:人工智能不会取代人类,但使用人工智能的人会取代不使用人工智能的人。然而,这句话并不够激动人心。

前不久,辞职的德国小伙做了一份长达165页的PPT,明确宣称AI将灭绝人类。他以一种危言耸听又神秘兮兮的方式说道:

“全世界可能有几百人可以亲眼目睹正在发生的事情,他们中的大多数人都在旧金山的各个人工智能实验室里。”

那就是问题所在。

绝大多数普通人根本不知道发生了什么。原子弹发明的时候,普通人不知道;叶文洁回答三体人的问题的时候,普通人也不知道……

更可怕的是天才们并不完全明白这一点。而且他们中的许多人并不是天才,而是野心勃勃的人。他们不是看到了就会看到,而是不知道会看到什么,但这丝毫没有阻止他们。

比如那位德国人,立刻就被质疑在招商引资,其实他很快就成立了AGI投资机构,资金也来自硅谷巨头。

资本市场需要故事,不管是乐观者,还是悲观者,他们离开时带走的故事都是为了市场。

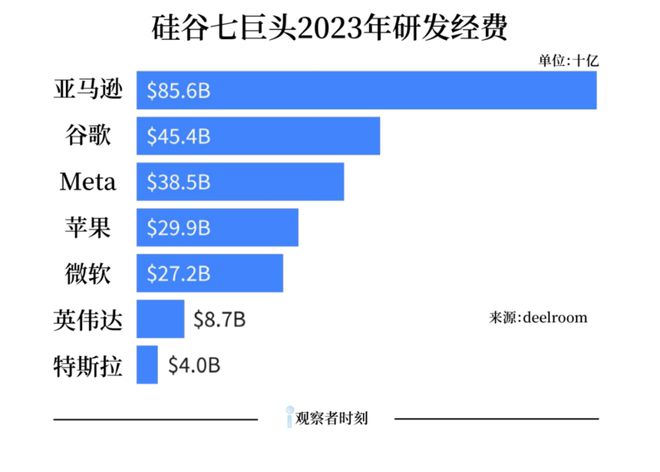

总市值超过10万亿美元的“硅谷七姐妹”,在过去一年里烧掉了1.7万亿美元,但换来的却是标普500指数约75%的增长。

在中国,AI领域玩家云集,顶尖玩家可以轻松获得大公司数亿美元的投资。

人工智能已经为一些人创造了可观的财富。仅在过去一年,全球科技界亿万富翁的财富就因人工智能而增加了约 7500 亿美元,这一数字超过了其他任何行业。

AI赛道的钱实在太多了,而这些钱几乎都来自于极少数的玩家。

过去两年,谷歌、微软等四家公司投入了全球近40%的AI风投,未来AI将获得数万亿美元的投资,创造数万亿美元的财富。

但与互联网繁荣相比,人工智能的中心化程度要高得多,最终有多少人能够掌控这些财富和智慧?

或者说,人工智能将彻底摆脱人类的控制,甚至取代人类。

不管结果如何,对于你我来说都不是一个好消息。

发表评论